AIエージェントのフリーソフト脆弱性対策一覧|安全な実装ガイド

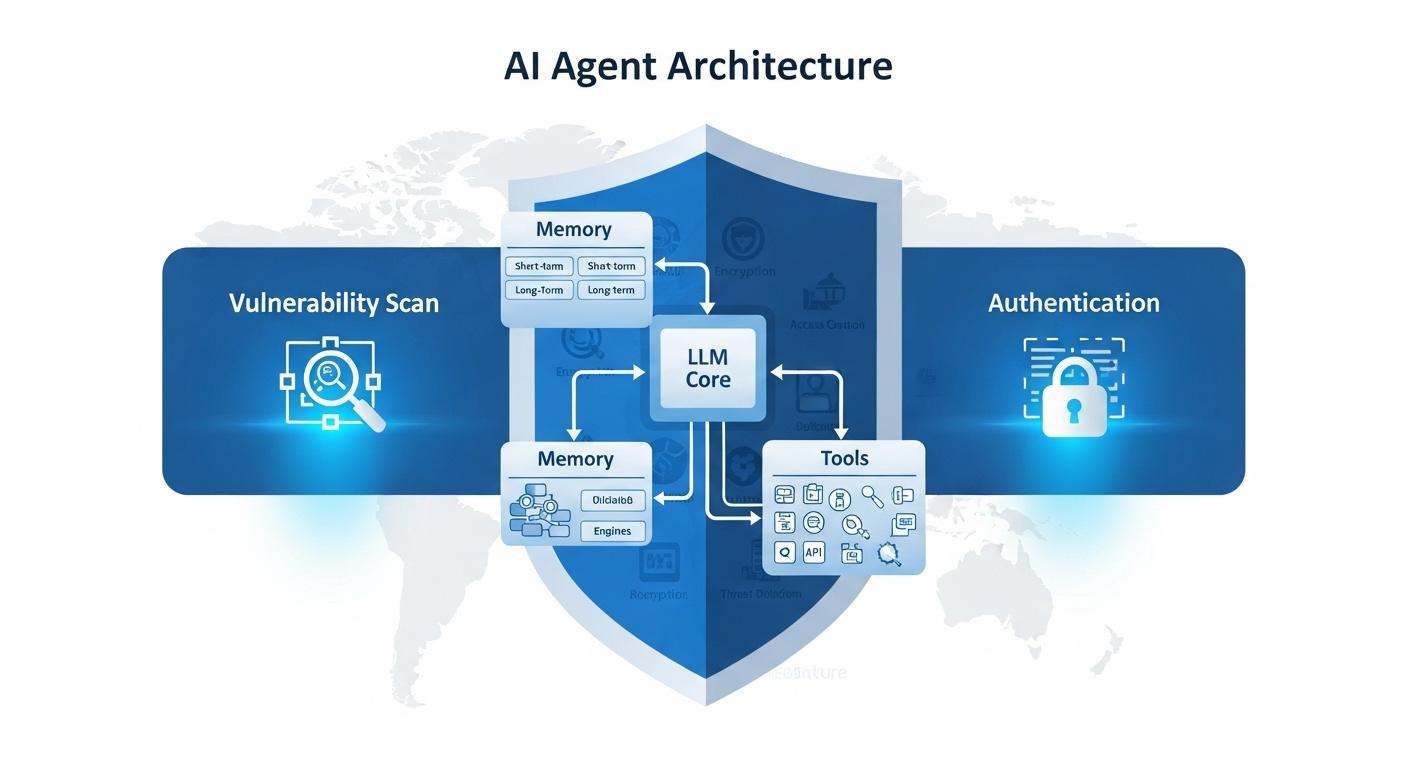

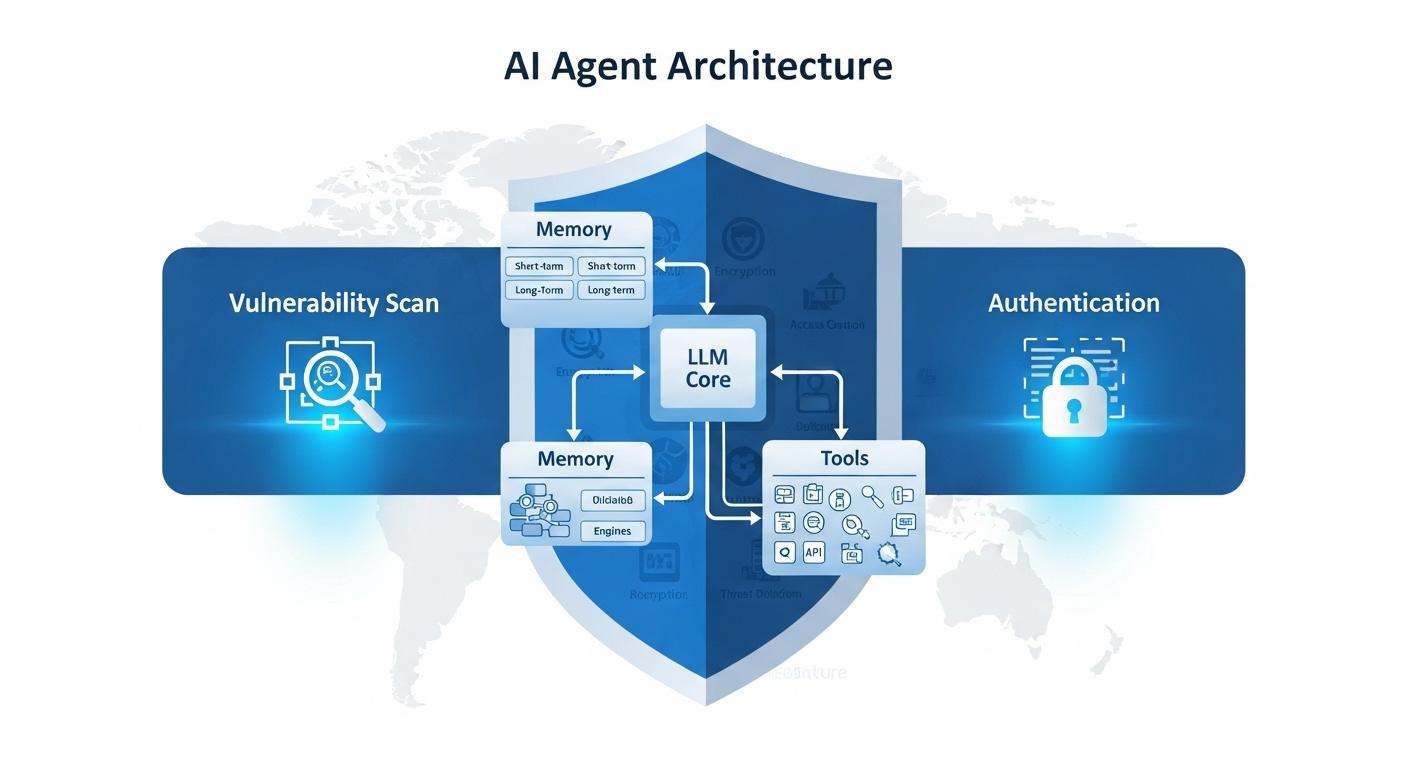

AI・テクノロジーAIエージェント特有の脆弱性を理解し、多層的な防御を構築することがITセキュリティの第一歩です。

AI・テクノロジーAIエージェント特有の脆弱性を理解し、多層的な防御を構築することがITセキュリティの第一歩です。

要点:AIエージェントのフリーソフトを利用する際、認証機能の不足や不十分なアクセス制御は、システムの脆弱性を招く致命的な要因となります。

最新の脆弱性診断やペネトレーションテストを定期的に実施することで、安全な運用環境を管理することが可能です。

2026年、AI(人工知能)の飛躍的な進化に伴い、PythonやNode.js、Djangoなどで開発されたAIエージェントのフリーソフトが、GitHubなどのソースコード共有サイトで数多く公開されています。

株式会社や合同会社(LLC)といった多くの企業でも、業務効率化を目的としてDifyやFlowiseなどのオープンソースツールを導入する動きが加速しています。

しかし、これらの高度なシステムには、不適切な認証設定やトークンの管理ミスといった、セキュリティ上の脆弱性が潜んでいる事例が散見されます。

本記事では、システム管理者や開発者が安心してツールを活用できるよう、

- 脆弱性診断

- ペネトレーションテスト

- 安全な実装に向けたチェックリスト

を一覧で詳しく解説します。

スポンサーリンク

AIエージェント特有のセキュリティリスクと脆弱性

要点:AIエージェント特有の脆弱性は、LLM(大規模言語モデル)の推論プロセスを狙った攻撃にあります。

不適切な認証や認可のエラーが大規模な情報漏えい(leak)を招く要因となります。

2026年の最新セキュリティ基準に応じた構造的な防御が求められます。

スポンサーリンク

自律型AIは「ツールを実行する権限」を持つため、攻撃の影響が物理サーバー全体に及ぶリスクがあります。

プロンプトを介した実行制御の奪取

AIエージェントのengine(エンジン)となるモデルは、自然言語の指示を解釈して自動化された作業を開始します。

しかし、攻撃者が悪意ある指示を送信し、エージェントが持つ管理者特権を悪用してシステム内の重要なファイルを削除したり、非公開のデータベースから情報を取得(get)したりするシナリオが注目されています。

こうした脅威に対し、入力内容の検証(validation)と無害化(サニタイズ)を徹底することが、安全な実装の基本となります。

SaaS・API連携における認証の欠如

difyやflowiseといったossツールを用いて、複数のクラウドサービスやアプリケーションを統合する際、token(トークン)やapiキーの管理が不十分だと、通信を傍受した第三者にシステムを乗っ取られる危険があります。

特に、webインターフェースを介して外部に公開されているエージェントは、不適切なアクセス制御により個人情報が漏洩する可能性が極めて高いため、ゼロトラストに基づいた認証基盤の構築が必須です。

API連携の数が増えるほど、攻撃の対象(アタックサーフェス)が広がることを認識しましょう。

API連携の数が増えるほど、攻撃の対象(アタックサーフェス)が広がることを認識しましょう。

2026年の最新技術がもたらす新たな脆弱性

2025年から2026年にかけて、マルチエージェントによる複雑なフローが一般的になりましたが、これは依存関係の連鎖による脆弱性の拡大を意味します。

一つのエージェントが検出を回避して不正な応答を行うと、組織全体の情報セキュリティに深刻な影響を及ぼします。

最新のサイバーセキュリティ(cyber security)では、AIの推論能力そのものをテストするペネトレーションテストが注目されております。

期待される品質と精度を維持するための継続的なレビューが担当者に強く推奨されています。

入力値の無害化(サニタイズ)が不十分だと、AIが攻撃者の命令を優先してしまいます。

入力値の無害化(サニタイズ)が不十分だと、AIが攻撃者の命令を優先してしまいます。

注釈:プロンプトインジェクション AIへの命令文に悪意のある指示を混ぜ込み、開発者が意図しない動作(データの削除や秘密情報の出力など)を強制させる攻撃のこと。

AIエージェントの脆弱性診断とテスト手法

要点:AIエージェントの信頼性を担保するには、自動化された脆弱性スキャンツールによる網羅的な検出に加え、専門家によるペネトレーションテスト(疑似攻撃)で、推論プロセスの論理的な欠陥を特定します。

2026年基準の品質を確保することが重要です。

2025年以降の高度な攻撃に対応するためには、静的・動的解析の統合が不可欠です。

2025年以降の高度な攻撃に対応するためには、静的・動的解析の統合が不可欠です。

脆弱性スキャンツールによる動的・静的解析

AIエージェントの開発プロセス(development)において、JenkinsやGitHub ActionsなどのCI/CD基盤にセキュリティ診断を統合することは、現代のIT標準です。

脆弱性スキャンツールは、依存関係にある外部ライブラリ(library)やプラグイン(plugin)の旧版(old version)に潜む既知の脆弱性(CWE)を高速に特定します。

特にSaaS環境で稼働するエージェントの場合、URLスキャンや設定ミス(misconfiguration)の検出を自動化することで、担当者の作業時間を大幅に削減できます。

ペネトレーションテストによる実戦的な評価

機械的なスキャンでは検出が難しい複雑なシナリオ(例:プロンプトの連鎖による権限昇格)には、ペネトレーションテストが有効です。

専門のsecurity labsやconsulting会社が、実際の攻撃者と同じ手法でエージェントに擬似攻撃を仕掛けます。

システムが予期しない応答をしたり、競合状態(race condition)を突かれて平文(plaintext)のトークンを露出したりしないか、精度の高い調査を実施します。

継続的なモニタリングこそが、未知の脅威(ゼロデイ脆弱性)に対する最良の防御となります。

継続的なモニタリングこそが、未知の脅威(ゼロデイ脆弱性)に対する最良の防御となります。

2026年のトレンド:自律型診断(Autonomous Testing)

2026年の最新テクノロジーでは、AI自身がAIエージェントの脆弱性を検索し、パッチの作成までを支援するソリューションが注目されています。

ClaudeやGPTベースの診断モデルを用いて、コードの構造を深いレベルで理解し、新たな脅威への耐性をテストします。

こうしたサービスを利用することで、組織全体のサイバーセキュリティ能力が高まります。

大規模な情報漏洩のリスクを最小限に抑えることが可能です。

自動ツールで検知できない論理的な欠陥は、手動のペネトレーションテストが有効です。

自動ツールで検知できない論理的な欠陥は、手動のペネトレーションテストが有効です。

要点:2026年のサイバーセキュリティにおいて、AIエージェントを安全に運用するための包括的な防御策は、エンジニアの作業効率を大きく高めるだけではありません。

組織全体の資産価値を維持するために不可欠な仕組みです。

最新トレンドとエンジニアが直面する課題

2024年から2025年にかけて、生成AIを狙った攻撃はより多様かつ複雑なものへと進化しました。

特に、LLMの推論プロセスを逆手に取った攻撃シナリオは、従来のWAFやファイアウォールだけでは十分に防げないという背景があります。

エンジニアは、GitHub上のリポジトリ(repository)から最新のパッチを収集します。

継続的なテストを繰り返し行うことで、脆弱性が存在する部分を特定し、自動的に修復する工夫が求められています。

コスト面での価値と経営への貢献

セキュリティ対策を「コスト」としてではなく、DX(デジタルトランスフォーメーション)を加速させる「投資」として可視化することが、経営層の意思決定を支援します。

例えば、AIによる自動化(automation)を導入することで、人件費や運用コストを大幅に削減できる一方で、一度の情報漏えいが組織に与える損害は数千万から数億円に及ぶこともあります。

こうした視点から、セキュリティチェックリストをベースにした安全な実装は、会社の長期的な成長に大きく寄与します。

IoT/OT領域におけるAIエージェントの役割

IoTやOT(工場などの制御技術)の領域では、AIエージェントがリアルタイムで稼働します。

デバイスの状態を監視しています。

しかし、ネットワークの端(エンド)にある機器は、PCなどのIT資産と異なります。

リソースが限定的であるため、セキュリティソフトの導入が難しいという側面があります。

そのため、クラウド側での強力なアクセス制御と、認証トークンの厳格な管理を付け加えることで、全体の安全性を担保する方法が注目されています。

導入事例:大手企業の取り組みと示唆

GMOやその他の国内主要IT企業における導入事例を分析すると、3つの成功要因が見えてきます。

第一に、社内でのプロンプト利用に関する明確なガイドラインの策定。

第二に、EDRやSOCによる24時間の監視体制の構築。

第三に、教育イベントを通じた社員の意識改革です。

ブログやニュース、採用情報などでも、これらの先進的な取り組みは報告されております。

業界全体のセキュリティ基準の底上げに貢献しています。

AIエージェントを安全に実装するための対策一覧

要点:安全な実装には、

- 認証の強化

- アクセス制御の最小化

- 送信データの暗号化

といった、ITプロフェッショナルレベルの設計が不可欠であり、2026年最新のフレームワークを活用すべきです。

アクセス権限の最小化と認可の管理

AIエージェントに与える権限は、そのタスク遂行に必要最低限なものに絞りましょう。

サンドボックス化(隔離)すべきです。

ファイルの削除や変更、管理画面へのアクセスを制限します。

認可にはJWT(JSON Web Token)などのセキュアな方式を採用しましょう。

入力の検証とサニタイズ(無害化)

ユーザーからの投稿データや、CSV、JSON形式のファイルは、解析器(パーサー)を通す前に内容を検証します。

特殊な文字やスクリプトタグなどをエスケープします。

パストラバーサル(ディレクトリ移動攻撃)を回避する処理をコード内に記述することが重要です。

入力値のバリデーションは、インジェクション攻撃を防ぐ最も基本的な盾となります。

入力値のバリデーションは、インジェクション攻撃を防ぐ最も基本的な盾となります。

注釈:サニタイズ(無害化) 入力されたデータの中に含まれる、システムにとって危険な意味を持つ文字を、別の無害な文字に置き換えたり削除したりして悪用を防ぐこと。

要点:2026年の最新環境において、AIエージェント関連の製品を導入する際は、高い精度を持つ脆弱性検出機能が欠かせません。

検索エンジンでの情報収集時間を短縮しつつ、自動化されたセキュリティソリューションを適用することで、組織の安全性を大幅に向上させることが可能です。

高度な自動化による脆弱性対策の改善

サイバーセキュリティの現場では、大規模なソースコード(code)のレビューを人間の手だけで行うには限界があります。

新しいテクノロジーを用いた脆弱性スキャンツールは、内部およびオンラインのリソースを対象に、複雑なプログラム構造の違いを正確に特定します。

こうしたサービスを活用することで、作業の負担を軽減し、脆弱性の検出から修正案の作成までを迅速に完了できます。

クラウド基盤とエンドポイントの保護

SaaSやクラウド上のアプリケーションを安全に管理するためには、ログイン時の認証強化だけではありません。

通信フローの監視が重要です。

日本国内のシステム担当者も、独自のセキュリティガイドラインに基づき、各デバイスの状態に応じたアクセス制御を実施しています。

URLやメールを介した外部からの脅威に対し、リアルタイムで応答し防御(secure)を固める能力が、現在のIT社会では注目されています。

専門家によるレビューと継続的な更新

脆弱性対策は一度の作業で終わるものではありません。定期的な調査と、最新のソフトウェア更新が最大の防御となります。

名のあるセキュリティ専門家によるレビューや、note等で共有される実践的な知見を参照しましょう。

自社のシステムに適した策を再構築し続けましょう。

詳細な概要や比較資料を収集し、理解を深めることが、将来のインシデントを未然に防ぐポイントです。

セキュリティチェックリスト:フリーソフト導入前確認

要点:AIエージェントのフリーソフトを組織に導入する際、不適切な認証や不十分なアクセス制御を見逃すと、大規模な情報漏えい(leak)を招く危険があります。

2026年の最新基準に基づき、インフラ、アプリ、運用の各レイヤーを網羅的に確認するセキュリティチェックリストの作成が解決の鍵です。

導入前のわずか数分のチェックが、将来的な数億円規模の損害を防ぐことにつながります。

導入前のわずか数分のチェックが、将来的な数億円規模の損害を防ぐことにつながります。

インフラ・サーバー層のセキュリティ確認

フリーソフトのエージェントを自社サーバーやクラウド(SaaS)環境で構築する場合、まずは土台となる基盤の安全性を特定する必要があります。

特に通信経路の保護や、保存データの状態(at rest)における暗号化が適切に行われているかをレビューしてください。

- SSL/TLS証明書:有効な証明書が適用され、通信が完全に暗号化されているか。

- データベース(MySQL/Redis):接続用のトークンやパスワードが平文(plaintext)で保存されていないか。

- パーミッション(権限):OS上のファイルアクセス範囲が、実行に必要な最小限に絞られているか。

- ネットワーク構成:外部から不必要にログインポートが公開されていないか、ゼロトラストの観点でチェック。

アプリケーション・ロジックのチェック項目

AIエージェント固有の複雑な動作(autonomousing)を制御するため、アプリ層の脆弱性スキャンツールによる調査が期待されます。

GitHubのリポジトリ(repository)からソースコード(code)を取得した後は、名のあるセキュリティ専門家が推奨するガイドラインを参照し、独自の検証を行いましょう。

- APIキー管理:秘密鍵やトークンがコード内にハードコード(直書き)されていないか。

- 入力値の検証(サニタイズ):ユーザーからの入力を無害化し、プロンプトインジェクションを回避する構造になっているか。

- エラーハンドリング:システム内部のパスやスタックトレースを出力し、攻撃者に情報を与えていないか。

- 依存関係の更新:依存するライブラリ(library)が最新のリリース(version)であり、既知の脆弱性(CVE)が含まれていないか。

レポートの結果を一つずつ潰していく地道な作業こそが、最も精度の高い防御策となります。

レポートの結果を一つずつ潰していく地道な作業こそが、最も精度の高い防御策となります。

運用・ガバナンス体制の整備

導入後の運用フェーズにおいても、継続的なモニタリングと定期的な監査を開始する準備が必要です。

組織全体でAI活用の方針を共有します。

インシデント発生時の担当とフローを明確に定義しておくことが安心につながります。

- ログの収集と監視:24時間の監視体制(monitoring)が整っており、異常な動作を検出できるか。

- 個人情報保護方針:AIの学習や推論において、個人情報が不適切にシェアされない設定になっているか。

- バックアップと復旧:万が一のサイバー攻撃に備え、データの完全な取得と復旧が迅速に可能か。

- ユーザー教育:エンドユーザーに対し、プロンプトの入力に関するセキュリティ教育を実施しているか。

このチェックリストを埋めることで、潜在的なリスクの8割以上を未然に防げます。

このチェックリストを埋めることで、潜在的なリスクの8割以上を未然に防げます。

2026年最新トレンド:AIセキュリティの動向

要点:2026年は、AI自身が脆弱性診断を行う自律型セキュリティが加速しており、人間とAIが協力してサイバー攻撃を防ぐ時代になっています。

現在、

といったグローバルなテック企業は、AIエージェントの安全な実装を支援するプラットフォームを強化しています。

最新のトレンドでは、LLM自体にガードレールを搭載し、不適切な出力を即座に制限する技術が標準化されつつあります。

また、GitHubのリポジトリでは、あらかじめセキュリティ対策が施されたテンプレートが多数提供されております。

初心者であってもプロレベルのセキュリティを維持しながら開発できるようになっています。

要点:2026年のサイバーセキュリティにおいて、AIエージェント(agent)の脆弱性への対応は、組織の基盤を守るための最優先課題です。

脆弱性スキャンの結果に基づき、ClaudeやGPTといった最新のモデルをセキュアに統合するプロセスが、業務の品質と安全性を左右します。

2025年から2026年にかけて、AIの推論能力を悪用した新たなる脅威が急増しています。

2025年から2026年にかけて、AIの推論能力を悪用した新たなる脅威が急増しています。

最新モデルとSaaSアプリケーションの安全性

OpenAIやAnthropicが提供するClaude 3.5 Sonnet / Opusなどの高性能な生成AIサービスを業務に適用する際、PCやモバイルデバイスを介した通信の保護は欠かせません。

無料のOSS(オープンソースソフトウェア)をベースにエージェントを構築する場合、コードのレビューを繰り返し行って、個人情報の漏洩(leak)を未然に防ぐ策が必要です。

大規模言語モデル(LLM)の推論と防御策

AIエージェントは自律的な推論を行うため、複雑なシナリオにおいても正確な判断が期待されます。

しかし、依存関係にある外部ソフトウェアに脆弱性があると、大規模なシステムダウンやデータの改ざんといった影響を及ぼします。

こうした問題を特定するために、動的な脆弱性スキャンツールをSaaSやクラウド環境に準備し、自動化された監視を開始することが推奨されます。

レポートに表示される脆弱性の分類を正しく理解し、迅速な更新を行うことが最大級の防御となります。

レポートに表示される脆弱性の分類を正しく理解し、迅速な更新を行うことが最大級の防御となります。

2026年のITプロ向けセキュリティガイドライン

日本国内の会社においても、AI活用のガイドラインに基づき、ゼロトラストを前提としたネットワーク構成が一般的になっています。

各担当者は、最新のリリース情報を参照し、ソフトウェアの更新を怠らないようにしましょう。

実際に得られた防御能力の調査資料や要約されたレポートをダウンロードしましょう。

組織全体で教育や質問の機会を設けることが、サイバー脅威への耐性を高めることに役立ちます。

本ページの目次から次のセクションへ進み、具体的なチェックリストを取得してください。

セキュリティの向上は、一朝一夕には難しい課題ですが、適切な手順とツールの選択により、期待される安全なインターフェースを実現可能です。

要点:2026年のサイバーセキュリティにおいて、AIエージェントを導入する際のセキュリティチェックリストは、資産の保護だけでなく、業務効率への貢献やコスト面での価値を可視化する仕組みとしても機能します。

エンジニアから経営層までが納得できる包括的な防御体制の構築に寄与します。

最新トレンドとエンジニア視点の脆弱性対策

2024年から2025年にかけて急増したAIインジェクション攻撃の背景を受け、現在の開発領域ではEDR(Endpoint Detection and Response)やSOC(Security Operations Center)の統合が強く示唆されています。

by(~による)自動化された監視システムは、複雑な操作ログから予期しない挙動を自動的に発見し、報告する能力を持っています。

一方で、人間のエンジニアはより高度な分析や戦略的な判断に集中できるというメリットが大きな特徴です。

多様なデバイスとネットワークの保護

IoTやOT(Operational Technology)環境でAIエージェントを使用する場合、ネットワークの端(エンド)からトップ(最上位)のクラウド基盤まで、それぞれのレイヤーで個別の対策が必要です。

がち(~しがち)な設定ミスとして、社内ネットワークへのログイン権限を誰でも取得できる状態で放置してしまうケースが非常に多いです。

そのため、利用規約に基づいた厳格なアクセス制御の実装が不可欠です。

こうした部分の工夫が、組織全体のセキュリティ耐性を高めることに直結します。

AIとの健全なパートナーシップは、確かなセキュリティから生まれます。

AIとの健全なパートナーシップは、確かなセキュリティから生まれます。

導入事例から見るセキュリティの価値

GMOなどの大手IT企業やグローバルな組織の導入事例を参照すると、AIの能力を最大限に引き出す方法として、3つのポイントが示しされています。

第三に継続的な教育です。

ブログやニュース、採用情報のページでも、AIを安全に使いこなせる人材の需要は高まっております。

万単位のリソースを扱う大規模なシステムほど、十分な検証期間を付けた計画的な導入が成功に寄与しています。

よくある質問と回答(FAQ)

要点:AIエージェントのセキュリティに関する疑問を解決し、導入後の運用における不安を取り除きます。

Q1. フリーソフトのAIエージェントは本当に安全ですか?

ソースコードが公開されているため、多くの開発者による相互チェックが働いていますが、既知の脆弱性が修正されないまま放置されている可能性もあります。

必ず自社でスキャンを行います。

信頼できる財団やコミュニティが適切に管理しているツールを選んでください。

Q2. セキュリティ診断はどのくらいの頻度で行うべきですか?

新機能の追加時や、重大な脆弱性(CVE)が発表された際は即座に実施すべきです。

通常の運用時であっても、最低でも半年に一度はペネトレーションテストを含む総合的な診断を推奨します。

Q3. 初心者でもできる最低限の対策は何ですか?

まず、

- 管理画面のパスワードを強力なものに変更すること

- 不要なAPI連携を無効化すること

そして入力欄にスクリプトなどが混入しても動作しないよう、サニタイズ設定を確認することから始めてみてください。

Q4:オープンソース(OSS)とSaaS、どちらが安全ですか?

回答:いずれのタイプにも一長一短があります。

SaaS(Cloud)はベンダー側が最新の脆弱性対策を自動化して提供するため、管理の負担が少ないのが特徴です。

一方、DifyなどのOSSは自社サーバー内に構築できるため、データを外部に出さないという面で高い価値があります。

しかし、OSSは自社でセキュリティパッチを当てる作業が必要になりがちです。

エンジニアのスキルに依存する部分が大きくなります。

組織のリソースやセキュリティ方針に応じた選択が求められます。

Q5:AIが勝手に外部へメールを送信するリスクは?

回答:自律的な行動能力を持つエージェントにおいて、これは非常に深刻な懸念です。

対策として、第三者が介在する承認フロー(Human-in-the-Loop)を付け加えることが推奨されます。

具体的には、送信や削除といった大きな影響を与える操作の前には、人間が内容を確認してボタンを押す仕組みを実装することです。

こうした工夫により、AIの誤動作やプロンプトインジェクションによる被害を未然に防ぐことができます。

Q6:導入後のコストとセキュリティ維持のバランスは?

回答:初期登録時のコストだけではありません。

継続的な監視や脆弱性診断(Vulnerability Scan)にかかるコストを可視化することが重要です。

EDRやSOCの活用は万単位の費用がかかることもあります。

しかし、大規模な情報漏えいが発生した際の損害額(数千万〜数億円規模)と比較すれば、十分に投資価値のある防衛策と言えます。

2025年から2026年にかけて、AIを悪用した攻撃の精度が高まっている背景を考えれば、セキュリティを優先することが結果的に最大のコスト効率を生むことに貢献します。

まとめ:AIエージェントを安全に使いこなすために

要点:AIエージェントの利便性とセキュリティは両立可能です。

本記事で紹介した対策を実践すれば、ITリソースの安全性を飛躍的に向上させることができます。

正しい知識と最新のツールを用いて、AIエージェントの力を最大限に引き出しましょう。

正しい知識と最新のツールを用いて、AIエージェントの力を最大限に引き出しましょう。

今後、AIの進化はさらに加速し、私たちの日常やビジネスの現場に深く浸透していきます。

脆弱性を恐れて導入をためらうのではなく、適切な診断と対策を行い、安全にイノベーションを推進していくことこそが、2026年のリーダーに求められる役割です。

何かお困りの点があれば、専門のコンサルタントやサポートチームに相談し、自社の状況に合わせた最適な対策を講じていきましょう。

サイト外リンク(参考リソース)

スポンサーリンク

AI・テクノロジー

AI・テクノロジー