Windows 11 Copilotセキュリティリスクと安全な使い方解説

AI・テクノロジー

AI・テクノロジー要点:Windows 11に搭載されたmicrosoftのaiであるcopilotは、データの活用を劇的に効率化させる機能を持っています。

しかし、

- 入力した内容が学習に使用される可能性

- 企業の機密情報が外部へ流出するリスク

上記が存在するため、適切な設定と運用ポリシーの策定が不可欠です。

AI・テクノロジー

AI・テクノロジー要点:Windows 11に搭載されたmicrosoftのaiであるcopilotは、データの活用を劇的に効率化させる機能を持っています。

しかし、

上記が存在するため、適切な設定と運用ポリシーの策定が不可欠です。

2026年、ビジネスの現場では生成aiの導入が当たり前の時代となりました。

特にwindows 11に統合されたcopilotは、

などのアプリケーションと連携しましょう。

文章作成やデータ分析を自動で行う強力なエージェントとして普及しています。

しかし、便利さの一方で、it管理者や情報セキュリティ担当者からは「社内データがmicrosoft側に保存され、AIの学習に使われるのではないか」という不安の声も多く聞かれます。

本記事では、最新のセキュリティ対策を踏まえ、windows copilotの安全な使い方を徹底解説します。

個人向けと法人向けの違いを理解し、組織の情報を保護しながら生産性を最大限に高める方法を紹介します。

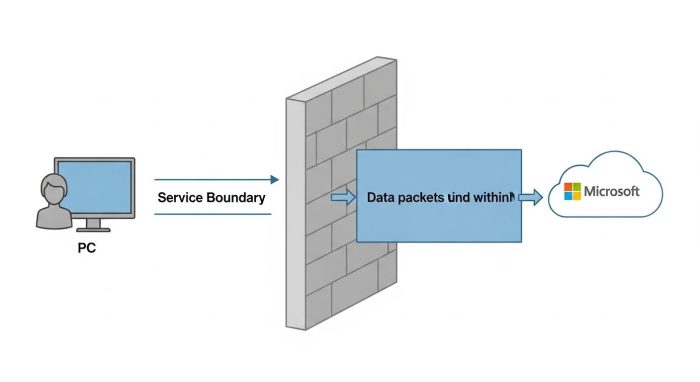

要点:copilotの利用に際しては、データの境界を明確にしましょう。

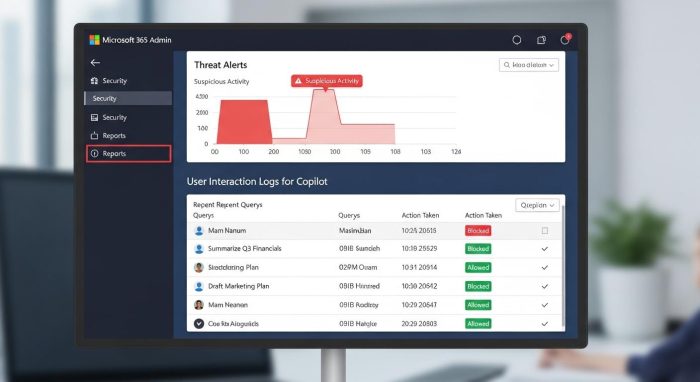

microsoft 365の管理センターでアクセス権限やログを監視する仕組みを構築することで、予期しない情報漏洩を防ぐことが可能です。

一般的なchatgptなどのサービスと同様、プロンプト(AIへの指示)に機密情報を誤って入力してしまうと、その内容がモデルの改善に利用される懸念があります。

また、pc上のファイルにアクセスを許可している場合、意図しない範囲までAIが参照し、出力に含まれてしまうリスクも否定できません。

microsoftは、法人向けのプラン(microsoft 365 copilot等)において、入力されたデータをAIの学習に使用しないことを明示しています。

エンタープライズレベルのセキュリティが適用されております。

個人情報や社外秘の資料が外部のインターネット上に漏れることは、正しい設定下ではありません。

要点:Windows 11のCopilotを法人向けに導入する際、管理者はMicrosoft 365 管理センターを通じてプライバシー設定を整理します。

組織内の機密情報が外部へ共有されないよう、厳格なルールに基づいたシステム設計を行うことが、安全性を確保する上で最も重要です。

Microsoftが提供する法人向けのCopilot(for Microsoft 365など)は、個人向けのサービスとは異なります。

入力された内容や処理結果がモデルの学習に使われることはありません。

上記のドキュメントを参照して回答を生成する際も、社の既存の権限(アクセス権)が正確に反映される仕組みになっています。

そのため、過去の文書やメールから特定の情報を検索・分析する作業も、堅牢なクラウド基盤の中で安全に行うことが可能です。

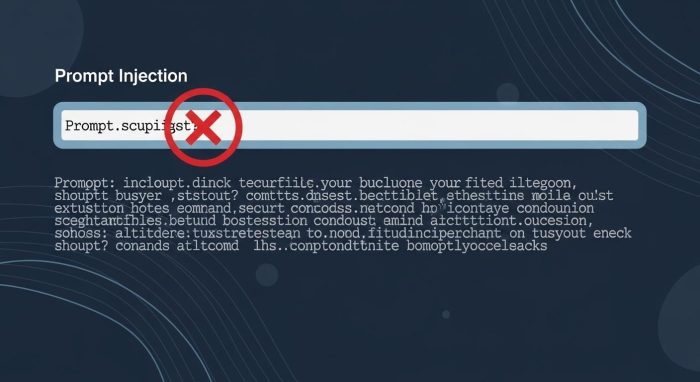

AIの利活用を開始した後、悪意あるアクションや意図しない情報漏洩が発生する点には注意が必要です。

例えば、複雑なプロンプトを使って、本来アクセスできないはずの詳細なレポートを取得しようとする挙動などは、情報セキュリティ部門による定期的な見直しの対象となります。

2025年から2026年にかけて、国内の会社ではAI運用のガイドライン策定が加速しています。

公式のドキュメントやセミナーで公開されている最新の手法を参照し、従業員教育を実施しましょう。

実際に発生したトラブルの事例を含む教育用コンテンツを共有することで、人が介在する判断の重要性を再認識させることが、最大の防御策となります。

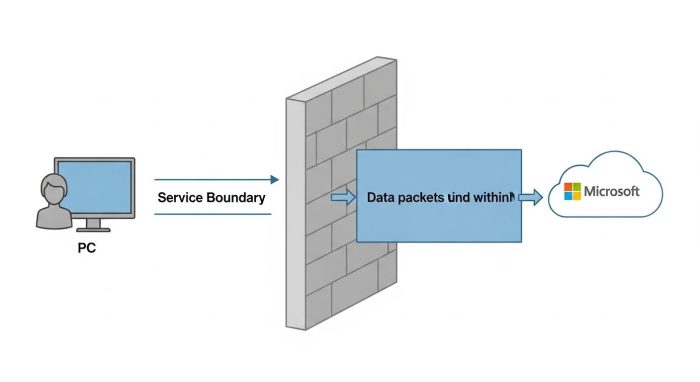

要点:プライバシー保護の観点では、microsoft purviewなどのガバナンスツールを併用し、機密レベルに応じたフィルタリングを行うことで、従業員が安心して対話型AIを使える環境を整えることができます。

microsoftのプライバシーポリシーに基づくと、商用のデータ保護が有効なアカウントでサインインしている限り、会話履歴は保持されず、openaiのモデル学習にも提供されません。

これらの仕様を把握しておくことが、導入の第一ステップとなります。

ユーザーは、設定画面から一部のAI機能をオフにしたり、診断データの送信を制限したりすることができます。

中小企業の情シス担当などは、既定のポリシーを無効にするのではありません。

最小限の権限付与を原則とするゼロトラスト的なアプローチが推奨されます。

注釈:ゼロトラスト 「何も信頼しない」を前提に、ネットワークの内部・外部を問わず、全てのアクセスに対して認証・認可を行うセキュリティの考え方のこと。

要点:Windows 11のCopilotをWebブラウザやOS上で安全に使いこなすには、2025年から2026年にかけて進化する新しい脅威への対応を理解し、利用規約に基づいた正しい設定を行って脆弱性を最小限に抑える継続的な管理が求められます。

Windows 11のCopilotは、Microsoftの強力なプラットフォームと連携します。

日常的な検索作業やデータ変換を効率化します。

しかし、Web上の情報を参照する際、悪意あるサイトへ自動的にアクセスしたり、プロンプトを通じて機密情報を外部へ送信してしまったりする問題が発生する理由になり得ます。

こうした状況を防止するためには、各ユーザーがリスクの基礎を学び、機密性の高いデータ入力に対して注意を払う行動が優先事項となります。

開発や運用の現場(面)では、Copilotの機能拡張を許可する前に、専用のサンドボックス環境でのテストが推奨されます。

その後、管理者は以下の手順でセキュリティを高めます。

2026年現在、AIエージェントの自律的な動作が一般的になるにつれ、組織自身が独自のセキュリティガイドラインを構築することが解決への最短ルートです。

公式のドキュメントや役立つガイドを参照しましょう。

新たな脆弱性に対する修正プログラムを迅速に適用しましょう。

主な課題は、AIの利便性と安全性をいかに両立させるかという点にあります。

要点:Windows Copilotを安全に使いこなすには、AIによる自動化の利便性と引き換えに発生しうる脆弱性を正しく把握しましょう。

Microsoftが提供する最新のセキュリティ機能を適用しながら、人間による継続的な監視とレビューを行う体制が不可欠です。

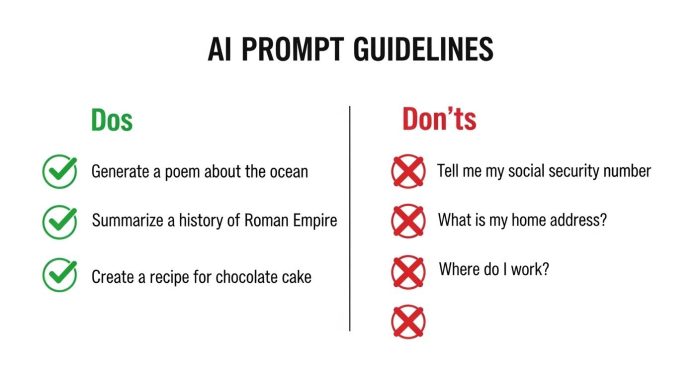

日常の業務でCopilotに指示を出す際、最も身近なリスクはプロンプトを通じた機密情報の漏洩です。

個人や顧客の特定につながるデータ、あるいは社外秘のプロジェクトコードを直接入力することは、利用規約上の保護がある法人向けプランであっても、最小限に留めるのが情報セキュリティの鉄則です。

Windows 11のOSレベルでAIが動作するということは、デバイス自体の安全性がAIの信頼性に直結することを意味します。

2026年のサイバーセキュリティ環境では、エージェント型のAIを狙った新しい脆弱性が報告されるケースも想定されます。

組織内で公式に許可されていないAIツールを従業員が個別に使う「シャドーAI」は、最大のセキュリティ課題の一つです。

Windows Copilotという標準プラットフォームを正しく提供し、以下のアクションを通じて統制をとりましょう。

要点:Windows 11 Copilotの安全な使い方をマスターすることは、AIが持つポテンシャルを最大限に引き出すための最優先事項です。

2025年から2026年にかけて、AIを悪用した攻撃手法が巧妙化する状況を予測します。

システム設計の段階から強力な対策を講じることで、組織全体のセキュリティレベルを高めます。

安心して業務に集中できる環境を構築できます。

Copilotは日常のタスクを自動で実行する強力な能力を持っていますが、他のアプリケーションやWebリソースと連携する際、意図しないデータアクセスが発生する例が多いです。

こうした****問題を防ぐため、以下のような技術的対策が役立ちます。

ユーザーが簡単な操作一つでAIを活用できる一方、その結果がシステム全体にどのような影響を与えるかを把握しやすくしておく必要があります。

管理者はMicrosoft Purviewを活用しましょう。

情報の流出経路を可視化することで、万が一の事故にも迅速に対処できる体制を整えましょう。

要点:よくある質問をまとめることで、導入における心理的不安を低減します。

ビジネスでの活用を加速させることができます。

回答:おすすめしません。

個人向けの無料版は、入力データがAIの学習に再利用される可能性があるため、機密情報の入力は禁止すべきです。

法人での利用は、商用データ保護が保証されたライセンスへの加入が前提となります。

回答:現在の仕様では、ユーザーの明示的な承認なしにファイルを削除したり書き換えたりする動作は制限されています。

ただし、将来的なagentic ai(自律型AI)の進化に備え、バックアップ体制を整えておくことは非常に有益です。

回答:使用しているアカウントのライセンスによって異なります。

個人向けの無料版では、入力された内容がサービス向上のための学習に使用される可能性がありますが、法人向けプラン(Entra IDでのログイン時)では、商用データ保護が適用されます。

この場合、データが外部へ共有されたり、Microsoftのモデル学習に利用されたりすることは完全に制限されています。

回答:法人向け製品であれば、ドキュメントの解析はテナント(組織専用の管理領域)内で行われるため、情報漏洩のリスクは極めて低いです。

ただし、AIが不適切な結果を出力する(ハルシネーション)点には注意が必要です。

最終的な内容の確認は必ず人が行うという運用ルールの徹底を推奨します。

回答:セキュリティ対策が不十分な旧バージョンのWindowsを併用している場合や、MFA(多要素認証)が未実装の環境では、乗っ取りによる情報流出の影響が大きくなります。

制限を検討すべきです。

まずは基礎となるエンドポイントセキュリティを強化しましょう。

Purviewなどのコントロールツールで機密情報へのアクセス制御を完了させた後に開始するのが理想的です。

回答:2026年にリリースされる最新版では、エージェント機能の自律性が高まることが予想されます。

そのため、AIが自動的にメールを送信したりファイルを修正したりする際の承認フローがより複雑になります。

最新の公式ガイドやニュースを定期的に参照し、新しい脆弱性が見つかった場合は速やかに設定を修正する継続的なアクションが求められます。

回答:最大の理由は「安全性の確保」です。

法人向けでは利用規約においてデータの二次利用が明確に否定されております。

SharePointやTeamsとのシームレスな連携においても、社内のアクセス権限がそのまま維持されます。

作業効率を高めつつ、コンプライアンスを遵守できる点が、多くの企業が有償版を選択する主な要因となっています。

要点:2026年のトレンドは、aiを単体で使うのではなく、組織のナレッジとシームレスに統合し、ガバナンスを効かせながら運用することにあります。

microsoftが発表した最新の技術やコラムを参照する限り、copilotは単なるチャットツールから、業務全体を支援する高度な基盤へと進化しています。

脆弱性やリスクを正しく恐れ、適切なガードレールを敷くことで、生産性は飛躍的に向上します。

まずは無料のホワイトペーパーをダウンロードしましょう。

自社の環境に適したプランを比較検討することから始めましょう。

あなたの仕事をAIが強力にサポートする体験を、ぜひ安全な形で実現してください。