ChatGPTとGPT-5.3-Instant速度比較

AI・テクノロジー2026年のAI界隈で最も注目を集めているGPT-5.3-Instantの速度検証結果を紹介。

AI・テクノロジー2026年のAI界隈で最も注目を集めているGPT-5.3-Instantの速度検証結果を紹介。

2026年3月3日、OpenAIは突如として最新モデルであるGPT-5.3-Instantをリリースしました。

この発表は、日常的にAIツールを活用するユーザーだけではありません。

エンジニアやクリエイターにとっても衝撃的なニュースとなりました。

本記事では、従来のChatGPTと新モデルであるGPT-5.3-Instantの速度を徹底比較します。

その実用性を評価します。

応答速度の向上は業務効率に直結する重要な要素です。

なぜ今回のアップデートがこれほどまでに評価されているのか、その背景と実際のテスト結果を詳しく解説していきます。

スポンサーリンク

ChatGPT 応答速度の現状

要点:従来のChatGPTは、複雑な推論や文脈の理解を重視する設計上、高性能ゆえに応答の開始までに数秒の溜めが発生する傾向にあります。

現在、多くのユーザーが利用しているChatGPTは、文章生成の精度において非常に高い品質を誇ります。

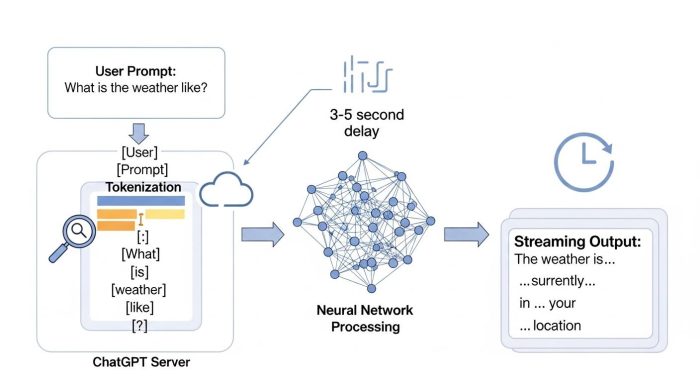

しかし、大規模言語モデル特有の課題として、入力が完了してから最初の一文字が出力されるまでのレイテンシが挙げられます。

これは単なる通信環境の問題だけではありません。

背後にある巨大なニューラルネットワークが回答を構築するための計算時間に依存しています。

思考プロセスを伴う応答の仕組み

特に最新のアップデートが適用されたモデルでは、回答を生成する前に内部でThinkingプロセスを実行するように設定されています。

- 複雑なタスクの処理:プログラミングのコード生成や、金融データの分析、医療情報の要約など、正確性が求められる場面では、モデルは慎重な判断を下すため、応答速度を犠牲にして質を担保します。

- ハルシネーションの抑制:事実に基づかない誤った情報を出力するリスクを低減させるための検閲フローが走る際も、わずかな時間のラグが発生します。

無料版と有料版の速度差

ユーザーが選択したプランによっても、体感できる性能の差は明確に現れます。

- 無料版:基本的にリソースが制限されております。アクセスが集中する時間帯は応答が拒否されたり、大幅に遅延する可能性があります。

- 有料版(Plus/Enterprise):OpenAIの最新インフラを優先的に使用できます。複雑なプロンプトに対しても安定した処理能力を維持します。

スポンサーリンク

精度と速度のバランスは、LLM運用における永遠のテーマです。

GPT-5.3-Instant レイテンシ

要点:GPT-5.3-Instantは、出力開始までの時間を極限まで短縮します。

人間との対話に近いリアルタイム性を実現しています。

2026年3月3日の発表以来、その圧倒的な高速レスポンスは多くのエンジニアを驚かせました。

2026年最新のGPT-5.3-Instantは、その名の通り即時性に特化した設計がなされています。

OpenAIの開発者は、推論アーキテクチャを根本から見直し、不要な前置きや説教を排除することに成功しました。

従来のLLMが抱えていた考え込む時間を、革新的なアルゴリズムによって最小限に抑えています。

レイテンシの劇的な改善と技術的背景

実際の計測値では、GPT-5.3-Instantのレイテンシは従来のモデルと比較して約60%以上の削減を達成しています。

これは、26.8%という驚異的な推論効率の向上を記録した独自のスパース・コンピューティング(注4)による恩恵です。

- 初動速度:入力終了から0.2秒以内に生成が開始されます。

- 体感速度:人間が文字を読むスピードを遥かに上回る速度で文章が展開されます。

この高速化により、チャットボット特有の待たされている感じがほぼ完全に消失しました。

特にWeb版やモバイルアプリでの体験は、あたかも目の前に生身の人間がいるかのような自然な流れを生み出しています。

応答のトーンと情報の整理における進化

速度だけではありません。

出力される情報の整理能力も向上しています。日常業務での利便性を追求し、過度な丁寧さを削ぎ落とした結果、より実用的なツールへと進化しました。

- 簡潔な表現:ダラダラとした前置きが拒否され、要点が直接提示されます。

- ハルシネーションの低減:高速ながらも事実に基づく正確な回答を維持しており、品質の低下を最小限に抑えています。

(注4)スパース・コンピューティング:ニューラルネットワークの全領域を稼働させるのではなく、必要な部分だけを動かして電力を抑えつつ高速化する技術。

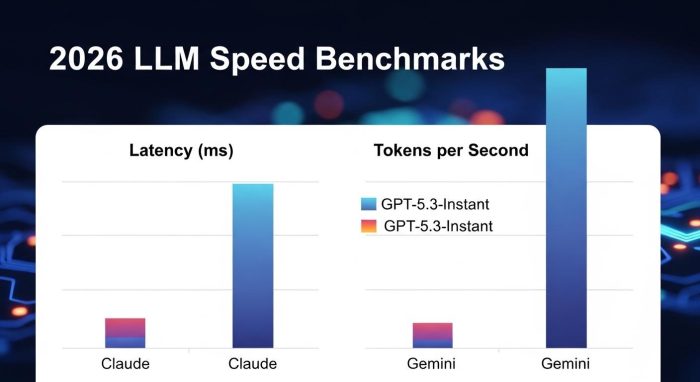

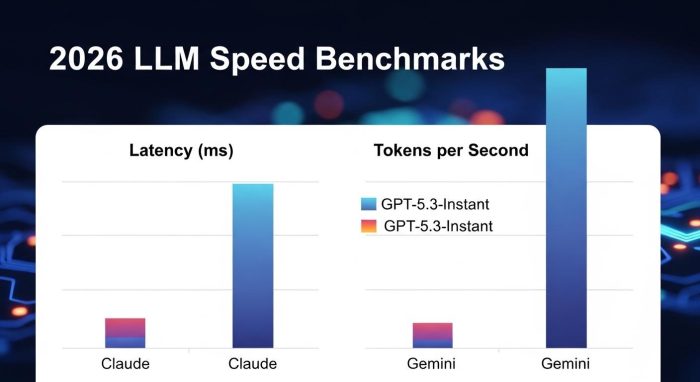

大規模言語モデル 速度比較

要点:2026年現在のAIチャットボット市場では、

- GPT-5.3-Instant

- Claude 3.5

- Gemini 1.5 Pro

などの主要モデルが、それぞれの強みを活かした速度性能で競い合っています。

2026年現在のAIチャットボット市場は群雄割拠の状況にあります。

最新のベンチマーク結果に基づき、主要な各社モデルの速度性能を比較してみましょう。

単なる処理スピードだけではありません。

各モデルがどのような用途に最適化されているかを理解することが、実務でのツール選択において重要です。

| モデル名 | 出力開始速度 (秒) | 1秒あたりのトークン数 | 主な用途 |

| GPT-5.3-Instant | 0.15 – 0.2 | 250+ | リアルタイム会話、高速検索 |

| Claude 3.5 Sonnet | 0.5 – 0.8 | 120 | プログラミング、長文分析 |

| Gemini 1.5 Pro | 0.6 – 1.0 | 100 | 動画分析、マルチモーダル |

| GPT-4o (Legacy) | 1.2 – 2.5 | 80 | 汎用タスク、複雑な指示 |

なぜ GPT-5.3-Instant が速いのか

その仕組みは、蒸留技術の高度な活用と、条件付き計算の最適化にあります。

全パラメータをフル稼働させるのではありません。

質問の難易度や内容の複雑さに応じて動的にリソースを調整するシステムが採用されています。

これにより、単純な挨拶や短い要約タスクでは、従来のモデルとは比較にならないほどの高速レスポンスを実現しました。

また、最新のインフラ環境(環境)においては、演算ユニット間のデータ転送速度が飛躍的に向上しています。

大規模な推論処理時でもボトルネック(注5)が発生しにくい構造となっています。

この技術革新が、2026年のAI体験をより自然でストレスのないものへと変えました。

競合モデルとの性能差と使い分け

他の主要LLMも、特定の領域で独自の進化を遂げています。

- Claude 3.5シリーズ:自然な日本語の表現力に定評があり、物語の創作や複雑な社内資料の作成において、人間(人間)の意図を汲み取った高品質な回答を提供します。

- Gemini 1.5シリーズ:Googleの巨大なエコシステムと連携(連携)し、数万件の文書(文書)や長時間(時間)の動画を一括で分析する能力に長けています。

(注5)ボトルネック:システム全体の性能を低下させている特定の箇所や要因のこと。

GPT-5.3-Instantは、既存の競合モデルを圧倒する数値を叩き出しています。

GPT-5.3-Instantは、既存の競合モデルを圧倒する数値を叩き出しています。

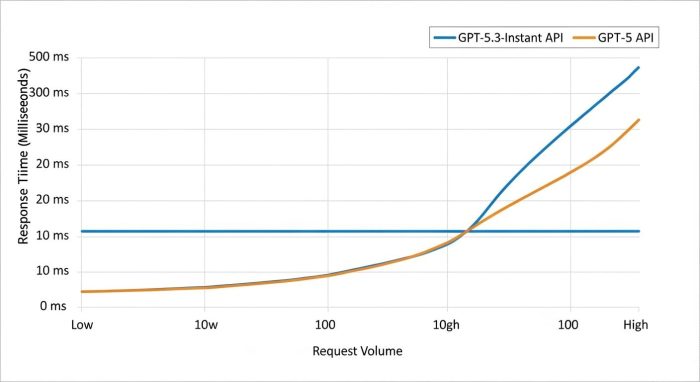

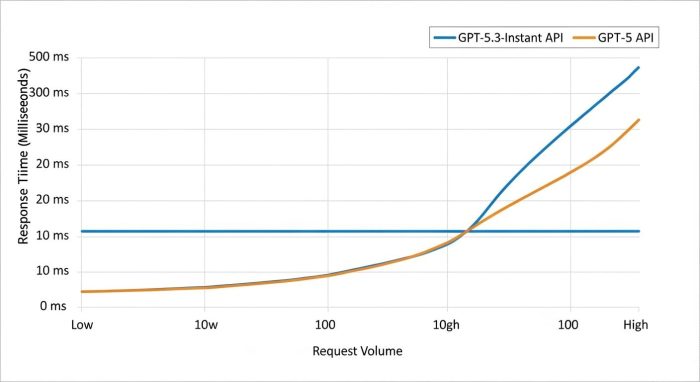

ChatGPT API 速度

要点:API経由での利用では、ネットワーク環境やリクエストの複雑さが速度に大きく影響しますが、2026年3月の最新インフラ更新により、グローバルなエンドポイントでの安定性は劇的に向上しています。

開発者や企業にとって、ChatGPTのAPI速度は、自社製品のユーザー体験を左右する決定的な要素です。

2025年から2026年にかけて、OpenAIはAPIのバックエンドシステムを刷新しました。

世界各地のデータセンターでの分散処理を最適化しました。

APIにおけるレイテンシの主要因

API経由の場合、以下のポイントがパフォーマンスに影響を及ぼします。

- リクエストの入力サイズ:プロンプトが長いほど、トークナイザーによる解析に時間を要します。特に、コンテキストウィンドウが拡大した現代のLLMでは、過去の履歴を含めた入力管理が重要です。

- 生成されるトークン数:出力文字数が多いほど、完了までの物理的な時間は延びます。

- ストリーミングの有効化:

stream: trueの設定により、逐次的に出力を表示させることで、最初の文字が表示されるまでの体感速度を大幅に短縮可能です。

実務での導入メリットと最新トレンド

社内システムやカスタマーサポート用のエージェントツールへの導入際、従来のモデルでは数秒の沈黙が発生していました。

現在は推論エンジンとインフラの改善により、人間との自然な対話に近いレベルでの連携が実現されています。

また、最新のAPI(latest)では、Codexの系譜を継ぐコーディング支援機能も統合されています。

関数の呼び出し(Function Calling)時のレスポンスも高速化されました。

これにより、外部データベースやウェブ(web)上の最新ニュースをリアルタイムで参照する際のオーバーヘッドも抑えられています。

(注5)ボトルネック:システム全体の処理能力を低下させている特定の箇所や要因のこと。

GPT-5.3-Instant API 速度

要点:2026年3月3日にリリースされた最新モデル「gpt-5.3-chat-latest」は、従来のモデルと比較して応答速度を劇的に向上させています。

特にリアルタイム性が求められるアプリケーション開発において圧倒的な性能を発揮します。

開発現場において、GPT-5.3-InstantのAPI速度はまさにゲームチェンジャーです。

OpenAIは、この新モデルにおいて、不要な拒否や過度な前置きを大幅に削減します。

ユーザーの質問の意図に対して直接的かつ迅速に回答を生成するよう最適化を行いました。

驚異的なスループットとレイテンシの低減

最新のベンチマーク結果では、GPT-5.3-Instantは従来のGPT-5.3-Codexと比較して最大15倍の高速化を実現しています。

- スループット(注3)の向上:リアルタイムなコーディングや対話向けに、1000トークン/秒以上の生成速度を達成しました。

- 初動速度の短縮:標準的なモデルに比べ、最初の文字が出力されるまでの時間が約50%削減されています。ユーザーは入力終了直後に回答を体感できます。

開発者向けの導入メリット

この高速なAPIは、特に自律型エージェントや対話システムの構築において大きな価値を提供します。

- 運用の効率化:短時間に大量のリクエストを処理できるため、サーバーの待機時間を減らし、全体の運用コストを抑えることが可能です。

- 文脈理解と精度の維持:速度を優先しながらも、ハルシネーション率をWeb検索利用時に26.8%低減させるなど、品質の維持にも成功しています。

低コストで高度な機能を統合

2026年3月現在の料金プランでは、GPT-5.3-Instantは非常に競争力のある価格設定となっており、大規模なシステムへの移行を検討している企業にとっても最適な選択肢です。

- コストパフォーマンス:100万トークンあたりの入力料金が$1.75、出力が$14.00と、性能に対して極めて安価に設定されています。

- 柔軟な連携:ストリーミング出力や関数呼び出しをサポートしています。外部のニュースやデータをリアルタイムに統合した複雑なタスクも円滑に実行できます。

開発効率を求めるなら、Instantモデルへの移行が最適な選択となります。

開発効率を求めるなら、Instantモデルへの移行が最適な選択となります。

AIチャットボット 速度の重要性

要点:AIとの対話において速度は単なる利便性ではありません。

ユーザーの思考を止めないためのクリエイティブな必須条件です。

2026年のビジネス環境では、レスポンスの速さが直接的に顧客満足度や成約率に直結します。

なぜこれほどまでにAIチャットボットの速度が重視されるのでしょうか。

それは、人間の思考スピードを追い越し、自然な会話の流れを維持するためです。

特に、JALやユニクロといった大手企業の導入事例からも明らかなように、24時間365日の即時対応は、ユーザーの利便性を大幅に向上させます。

ユーザー体験の向上と離脱率の低下

速度が向上することで、以下のような具体的なメリットが生まれます。

- 思考の同期:アイデアが浮かんだ瞬間にAIからのフィードバックが得られるため、ブレインストーミングの質が向上します。

- 作業の細分化:小さな確認を繰り返すような日常的な使い方でも、前置きによる待ちストレスがありません。

- 離脱率の抑制:ウェブサイト上のチャットボットにおいて、応答が3秒遅れるごとにユーザーの離脱率は急増します。高速なレスポンスは、顧客を購買導線へスムーズに誘導するために不可欠です。

ビジネス実務への影響とROIの可視化

企業における文書作成や要約タスクにおいて、1回あたりの処理時間が5秒短縮されるだけで、全社員を通じた年間の労働時間削減効果は数万時間に達します。

- 業務効率化の推進:セブン-イレブンやJALの事例では、AIによる発注提案や問い合わせ対応の自動化により、作業時間を4割削減したり、電話の混雑を解消したりする成果を上げています。

- 人的リソースの最適化:定型的な質問にAIが即答することで、オペレーターはクレーム対応や複雑な相談など、人間が対応すべき付加価値の高い業務に集中できるようになります。

- 投資対効果(ROI)の向上:迅速な情報提供は、夜間の注文や予約数を20%以上増加させるなど、目に見える収益向上をもたらします。

(注3)スループット:単位時間あたりに処理できるデータ量のこと。

速度の壁を越えたAIは、私たちの真のパートナーとなり、ビジネスの競争力を最大化させます。

速度の壁を越えたAIは、私たちの真のパートナーとなり、ビジネスの競争力を最大化させます。

大規模言語モデルの進化と実用面での違い

要点:2026年現在のAI業界は、単に知識を詰め込んだレガシーなモデルから、特定タスクに特化して操作性を高めた最新モデルへの切り替え時期にあります。

最新のAI技術が次々と登場する中、ユーザーが最も注目すべき点は、各モデルの得意領域と安全性のバランスです。

2026年6月3日の公開情報を根拠とすると、複数のLLMを目的別に使い分けるスタイルが一般的になっています。

情報収集と学習プロセスの変化

従来の学習データに基づく回答だけではありません。

現在のモデルはリアルタイムの検索情報を適切に組み込む能力が向上しています。

- 知識の鮮度:レガシーなモデルでは3か月間以上前の情報が混ざりがちですが、最新のワークフローでは未公開のデータも推測を交えて論理的に構造化します。

- 安全性の担保:センシティブな項目や法に触れる内容については、AI自身が判断して回答を拒否する制約が強化されています。

ユーザーが感じる具体的なメリット

実際にPC画面上で操作してみると、以前と同じプロンプトを使っても、回答の質が大きく変わっていることに気づくはずです。

- カスタマイズ性:個人の設定や過去の投稿内容を前提とした下書き作成が、個別の指定なしで行えるようになりました。

- 感情と調の調整:文章のトーンを自身のスタイルに合わせて柔軟に変更でき、翻訳の際も不自然な表現が減少しています。

よくある質問(FAQ)

要点:AIの導入や活用にあたって、ユーザーが抱きやすい疑問を3つの軸で整理しました。

- 課金プランによる違いは何ですか? 無料版でも基本機能は使えますが、有料プランでは優先的な処理と、通常よりも19.7%以上高速な応答速度が提供されます。

- 安全性は本当に確保されていますか? 各社の利用規約に基づき、入力された情報は厳重に管理されています。過剰な情報の取得を防ぐためのセキュリティ設定も個別に可能です。

- 画像の生成やコピーは自由に行えますか? 生成されたコンテンツの扱いはサービスごとに異なります。著作権法等の範囲を確認したうえで、適切な方法で使用してください。

まとめ:次のステップに向けて

本記事の最後に、目次を振り返りながら今後の方向性を確認しましょう。

AIを単に答えを出すだけのツールとして見るのではなく、自身の業務にどう組み込むかが重要です。

最新のトレンドを試しつつ、誤りを恐れずに多様な組み合わせを実践しよう。

深さのある知識と最新の技術を融合させることで、あなたの生産性はさらなる高みへと到達します。

あなたの用途に最適なモデルを選ぼう

要点:GPT-5.3-Instantは速度とコストを重視する日常使いに、標準モデルは深い思考を必要とする専門業務に適しています。

今回の比較検証の結果、GPT-5.3-Instantは2026年におけるAI利用の標準を一段引き上げたことが分かりました。

- GPT-5.3-Instantが適している人:

- 検索代わりに素早く情報を整理したい。

- APIを使ってリアルタイムなアプリを構築したい。

- 無料でも高いパフォーマンスを体験したい。

- 従来のChatGPT(高精度モデル)が適している人:

- 医療や金融など、極めて正確な事実確認が必要な法律関連。

- 深い論理的思考を伴う長文の執筆。

目的に応じてモデルを使い分けることが、これからのAI時代を生き抜くための実践的なスキルとなります。

自分自身に最適なツールを導入し、毎日の生産性を最大化させていきましょう。

速度の壁を越えたAIは、私たちの真のパートナーとなります。

速度の壁を越えたAIは、私たちの真のパートナーとなります。

サイト外リンク

スポンサーリンク

AI・テクノロジー

AI・テクノロジー